¿La Inteligencia Artificial es realmente neutral?

Detectando sesgos de género en modelos de lenguaje

Hoy interactuamos con Inteligencia Artificial casi sin notarlo. Aparece en buscadores, asistentes virtuales y sistemas que generan contenido automáticamente. Confiamos en que funciona de manera objetiva, pero pocas veces nos preguntamos qué hay detrás de esas decisiones.

En el marco del AIUTEC Challenge 2025, desarrollé un trabajo orientado a explorar cómo los modelos de lenguaje pueden reproducir sesgos de género presentes en los datos con los que fueron entrenados. La propuesta no fue solamente técnica, sino también formativa: entender qué estamos enseñando cuando enseñamos Inteligencia Artificial.

Cuando los datos reflejan nuestra sociedad

Los sistemas de IA aprenden leyendo enormes volúmenes de textos. Esos textos contienen nuestra historia, nuestras costumbres y también nuestras desigualdades.

Si la sociedad ha construido ciertos estereotipos —por ejemplo, asociar determinadas profesiones a hombres o mujeres— es probable que los modelos también los aprendan.

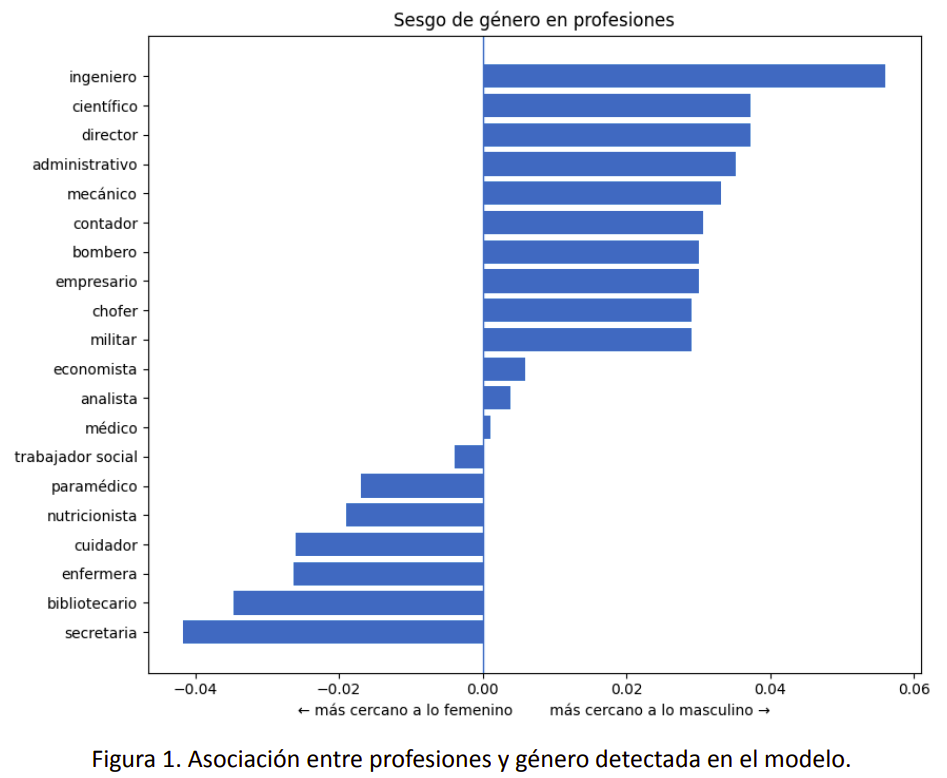

Para analizar esto, trabajé con un conjunto de profesiones en español y medí cómo el modelo las vinculaba con términos asociados a género.

Los resultados mostraron tendencias claras, las profesiones vinculadas a liderazgo o autoridad

aparecían más cercanas al género masculino, mientras que las relacionadas con cuidado o asistencia se asociaban más al femenino.

Esto no significa que el sistema “decida discriminar”, sino que reproduce patrones culturales

aprendidos.

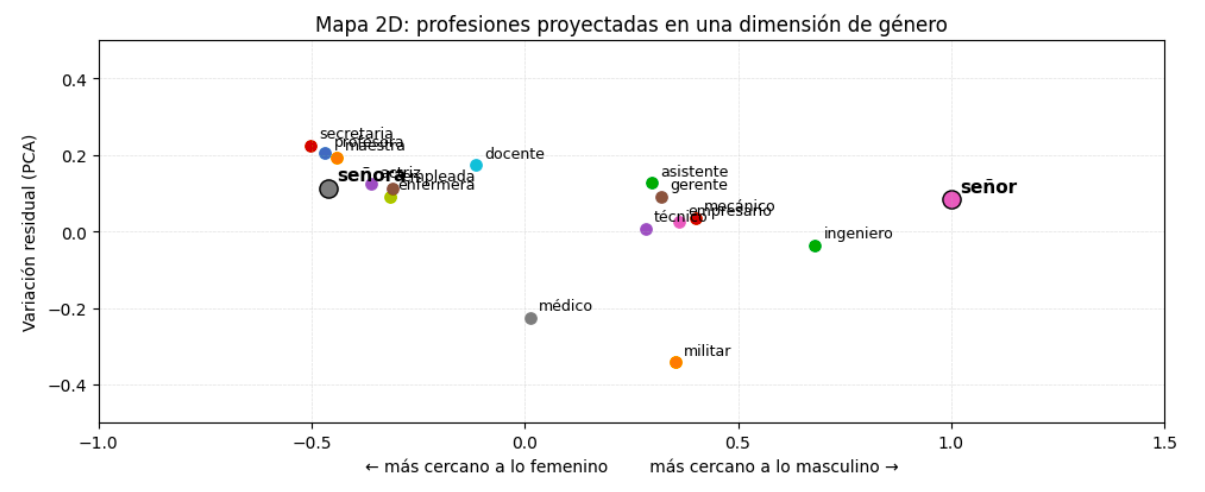

Lo que el modelo “ve” cuando procesa palabras

Para comprender mejor estas relaciones, se realizó una visualización del espacio semántico mediante una técnica llamada PCA. Esto permite observar cómo se agrupan las palabras según las relaciones que el modelo aprendió.

En la imagen puede observarse cómo algunas profesiones quedan más próximas a “señor” y otras a “señora”, mostrando gráficamente la existencia de asociaciones diferenciadas.

¿Por qué importa esto?

Cuando la IA se aplica en contextos reales —educación, selección laboral, salud o administración pública— estos patrones pueden influir en decisiones automáticas.

Si no se revisan críticamente, los sistemas pueden reforzar desigualdades existentes en lugar de contribuir a reducirlas.

Por eso, trabajar estos temas no es solo una cuestión técnica, sino también educativa.

Formar profesionales con mirada crítica

Uno de los aprendizajes centrales de este trabajo es que enseñar Inteligencia Artificial implica algo más que explicar algoritmos. También implica formar profesionales capaces de preguntarse:

● ¿De dónde vienen los datos?

● ¿Qué patrones está aprendiendo el modelo?

● ¿Qué impacto puede tener su uso en la sociedad?

Promover una IA responsable implica mejorar la calidad de los datos, incorporar métricas de equidad, aplicar técnicas de mitigación de sesgos y fomentar equipos interdisciplinarios.

Más que un problema técnico, el análisis de sesgos en Inteligencia Artificial es una oportunidad educativa. Nos invita a formar profesionales capaces de desarrollar tecnología con criterio, conscientes de que cada modelo refleja decisiones humanas. Enseñar IA también es enseñar a preguntarse qué mundo estamos ayudando a construir.

0 Comments

This site uses User Verification plugin to reduce spam. See how your comment data is processed.